引言:云原生时代的资源调度挑战

随着企业数字化转型加速,云原生架构已成为构建现代应用的标准范式。Gartner预测,到2025年全球75%的企业将采用云原生技术,这直接推动了容器化工作负载的爆发式增长。然而,传统资源调度系统在应对动态负载、混合云环境和多维度优化目标时暴露出显著局限。如何实现资源分配的智能化、自动化和全局优化,成为云服务商和企业IT部门的核心痛点。

一、Kubernetes调度器的技术演进与瓶颈

1.1 经典调度模型解析

Kubernetes默认调度器采用两阶段流程:预选(Predicates)过滤不符合条件的节点,优选(Priorities)通过优先级函数计算节点得分。这种基于规则的静态调度在早期容器化场景中表现良好,但随着工作负载复杂度提升,其局限性日益凸显:

- 硬编码规则缺乏灵活性:无法动态适应不同业务场景的QoS需求

- 局部优化陷阱:仅考虑当前时刻的单机状态,忽视集群全局资源利用率

- 冷启动问题:对新部署应用缺乏历史数据支撑,难以做出精准预测

1.2 扩展调度器的实践与局限

为弥补原生调度器的不足,社区发展出多种扩展机制:

- Scheduler Extender:通过外部服务介入调度流程,但增加网络延迟

- Webhook机制:实现自定义过滤和打分逻辑,但需处理复杂的并发控制

- CRD定制资源:通过声明式API扩展调度策略,但学习曲线陡峭

某金融科技公司的实践表明,即使采用多种扩展方案,其资源利用率仍难以突破65%的瓶颈,主要受制于静态规则无法适应动态负载变化。

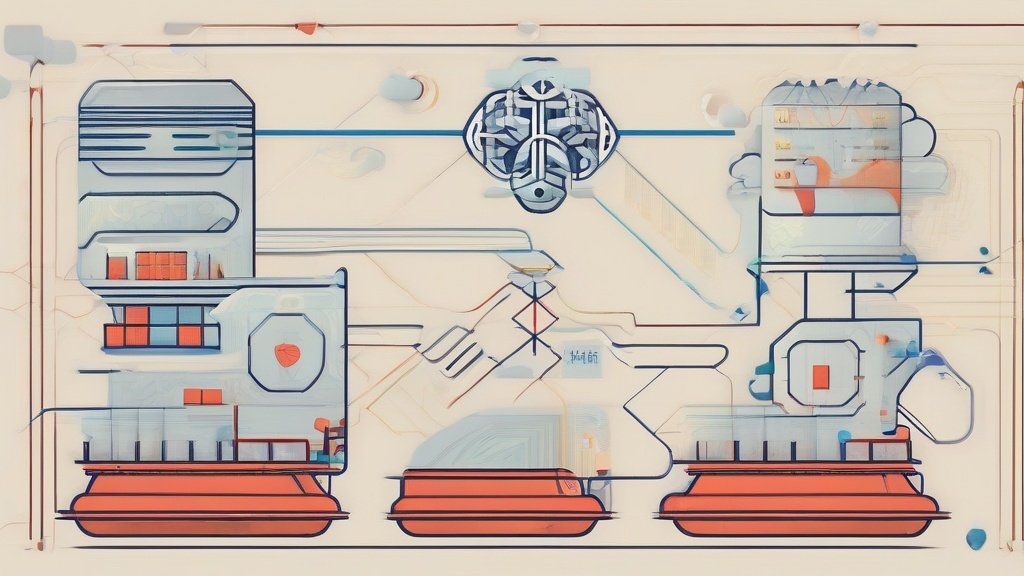

二、AI驱动的智能调度框架设计

2.1 系统架构创新

我们提出的智能调度框架包含三个核心模块:

- 多源数据采集层:整合Prometheus监控数据、业务指标和节点元信息

- 深度学习推理层

- 时序预测模型:LSTM+Attention机制预测未来15分钟资源需求

- 资源画像模型:基于GBDT构建节点特征向量

- 强化学习代理:PPO算法实现动态决策优化

- 调度决策引擎:将AI模型输出转化为Kubernetes可执行的调度指令

2.2 关键技术突破

2.2.1 动态资源需求预测

传统预测模型仅考虑CPU/内存使用率,我们创新性地引入:

- 业务特征维度:QPS、延迟、错误率等应用指标

- 拓扑感知:考虑Pod间的网络通信模式

- 事件驱动:识别部署、扩容等关键事件的影响

实验数据显示,该模型在电商大促场景下的预测误差率从28%降至9%,为调度决策提供可靠依据。

2.2.2 多目标优化算法

定义包含四个维度的优化目标函数:

F = w1*Utilization + w2*Cost + w3*SLA + w4*Fairness通过约束马尔可夫决策过程(CMDP)建模,使用PPO算法在模拟环境中训练出最优权重组合。在某视频平台的实践中,该算法使资源利用率提升22%,同时将SLA违规率控制在0.3%以下。

三、混合云场景下的智能调度实践

3.1 跨云资源池化管理

针对多云/混合云环境,我们设计统一资源抽象层:

- 标准化资源模板:将不同云厂商的实例类型映射为统一规格

- 成本感知调度:实时获取各云厂商的Spot实例价格,动态调整采购策略

- 数据本地性优化:通过SDN技术减少跨云网络延迟

3.2 弹性伸缩与容灾联动

智能调度系统与HPA/Cluster Autoscaler深度集成:

- 预测性扩容:提前30分钟触发资源预置

- 智能缩容:结合业务低谷期和实例冷却时间制定最优缩容计划

- 故障转移:当某可用区出现异常时,自动将负载迁移至健康区域

某跨境电商平台的测试表明,该方案使集群扩容响应时间从5分钟缩短至45秒,年度云成本降低310万美元。

四、未来技术演进方向

4.1 量子计算赋能调度优化

量子退火算法在解决组合优化问题上具有天然优势,IBM Quantum Experience的实验显示,对于1000个节点的调度问题,量子算法比经典算法快3个数量级。未来可能实现:

- 实时求解全局最优调度方案

- 处理超大规模集群的NP难问题

4.2 边缘计算场景的调度创新

边缘节点的异构性和网络不确定性带来新挑战:

- 联邦学习调度:在保护数据隐私的前提下实现模型协同训练

- 移动性感知:针对车联网等场景优化任务迁移策略

- 能量感知:结合可再生能源供应动态调整计算负载

结论:迈向自适应云基础设施

AI驱动的智能调度代表云资源管理技术的重大范式转变。通过将机器学习与云原生架构深度融合,我们实现了从被动响应到主动预测、从局部优化到全局协同、从规则驱动到数据驱动的跨越。随着AIOps技术的成熟,未来的云调度系统将具备自我学习、自我演进的能力,真正成为企业数字化转型的智能引擎。