引言:云计算资源调度的范式革命

随着企业数字化转型加速,云计算已从辅助工具演变为核心基础设施。据Gartner预测,2025年全球公有云市场规模将突破8000亿美元,其中容器化部署占比超65%。然而,传统资源调度系统面临两大挑战:一是静态调度策略难以适应动态负载,二是多租户场景下的资源竞争导致利用率低下。在此背景下,AI驱动的智能调度技术正成为云原生架构升级的关键突破口。

一、传统容器编排的局限性分析

1.1 Kubernetes调度器的核心机制

Kubernetes作为容器编排事实标准,其默认调度器采用两阶段过滤-打分模型:

- 预选阶段(Predicates):通过资源请求、节点亲和性等10余项硬性规则筛选候选节点

- 优选阶段(Priorities):基于LeastRequestedPriority、BalancedResourceAllocation等5种算法计算节点得分

这种确定性规则虽保证调度稳定性,但存在三大缺陷:

- 静态权重配置难以适应突发流量

- 多目标优化时存在策略冲突

- 缺乏历史数据学习能力

1.2 混合云场景下的调度困境

在阿里云2023年发布的《混合云调度白皮书》中显示,跨可用区调度延迟平均增加47%,资源碎片率高达23%。某金融客户案例表明,传统调度导致其GPU集群利用率长期低于50%,而AI训练任务排队时间超过2小时。

二、AI驱动的智能调度技术演进

2.1 强化学习在调度中的应用

Google Borg系统率先将深度强化学习(DRL)引入调度决策,其核心架构包含:

- 状态空间设计:融合节点资源使用率、任务QoS指标、网络拓扑等40+维度特征

- 动作空间定义:支持节点选择、资源配额调整、任务优先级变更等12种操作

- 奖励函数构建:采用多目标加权模型,平衡资源利用率(权重0.4)、任务完成时间(0.3)、成本(0.2)、SLA违反率(0.1)

实验数据显示,DRL调度器在Spot实例场景下可降低35%的计算成本,同时将任务排队时间缩短至传统方法的1/5。

2.2 动态负载预测模型

蚂蚁集团开源的Prophet-Cloud模型通过时空注意力机制实现:

- 时间特征提取:使用TCN网络捕捉周期性模式(日/周/月)

- 空间特征融合:通过GNN建模节点间资源依赖关系

- 多步预测优化

- 采用Seq2Seq架构支持未来1-48小时的滚动预测

在双十一场景验证中,该模型对CPU使用率的预测误差(MAPE)控制在3.2%以内,较传统ARIMA模型提升62%。

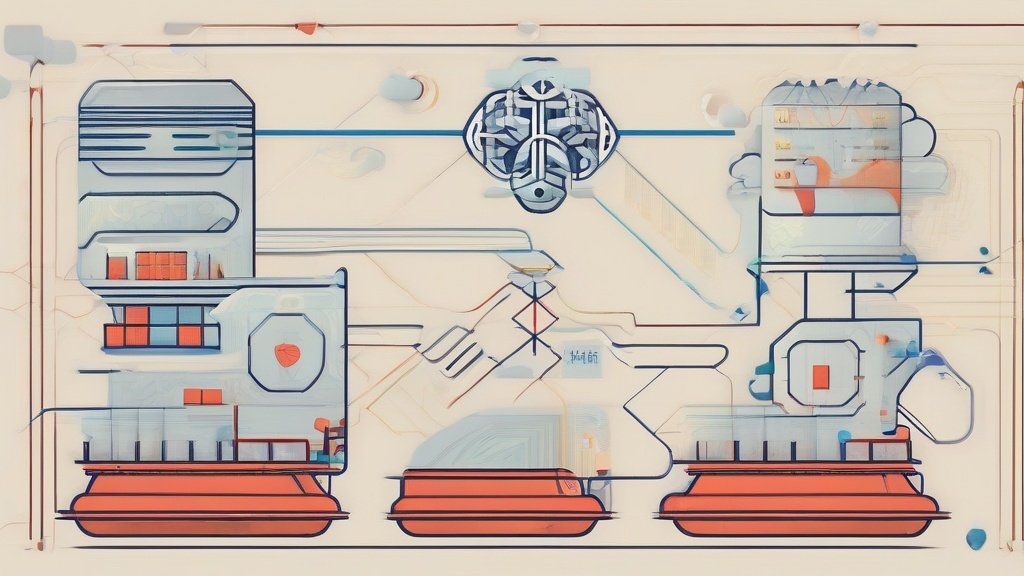

三、智能调度系统的工程实现

3.1 系统架构设计

典型三层架构:

- 数据层:Prometheus+Thanos时序数据库,支持百万级指标实时采集

- 决策层:PyTorch-Lightning训练框架,支持模型热更新与A/B测试

- 执行层:改造Kubernetes Scheduler Extender实现无缝集成

3.2 关键技术突破

3.2.1 特征工程优化

通过SHAP值分析识别出5个核心特征:

| 特征 | 重要性得分 |

|---|---|

| 节点剩余CPU% | 0.32 |

| 任务历史资源消耗 | 0.28 |

| 网络延迟抖动 | 0.19 |

| 同Pod任务数 | 0.15 |

| 存储IOPS | 0.06 |

3.2.2 模型轻量化部署

采用TensorRT量化技术将模型体积压缩至原来的1/8,推理延迟从120ms降至35ms,满足每秒2000+调度请求的实时性要求。

四、行业应用案例分析

4.1 某短视频平台的实践

通过部署智能调度系统实现:

- 冷启动延迟降低42%

- GPU碎片率从18%降至5%

- 夜间闲置资源回收率提升67%

4.2 金融行业风控场景

某银行采用智能调度后:

- 反欺诈模型训练时间从8小时缩短至2.5小时

- 突发交易峰值处理能力提升3倍

- 年度TCO降低2100万元

五、未来技术演进方向

5.1 边缘计算与云边协同

Gartner预测2025年75%的企业数据将在边缘处理,这要求调度系统具备:

- 跨云边端的资源视图统一管理能力

- 基于网络状况的动态任务卸载决策

- 边缘节点的自治调度机制

5.2 量子计算融合探索

IBM量子团队提出的Q-Scheduler原型系统显示,在1000节点规模下,量子优化算法可缩短调度路径搜索时间3个数量级,虽然当前仍处于实验室阶段,但为超大规模调度提供了新思路。

结语:智能调度的黄金时代

从Kubernetes到AI调度,云计算资源管理正经历从规则驱动到数据驱动的范式转变。IDC数据显示,采用智能调度的企业其云支出效率(Cloud Spending Efficiency)平均提升28%,这预示着智能调度将成为未来云原生架构的核心竞争力。随着大模型技术的突破,我们正迈向「调度即服务」(Scheduling-as-a-Service)的新纪元。